За двадцать с лишним лет в SEO я вытащил из забвения сотни сайтов. И знаете, что я скажу честно? В трёх случаях из десяти причиной полного обвала органического трафика оказывались не алгоритмы Яндекса, не действия конкурентов, не «фильтры» и не вирусы. А ровно одна строка в файле, который весит меньше килобайта.

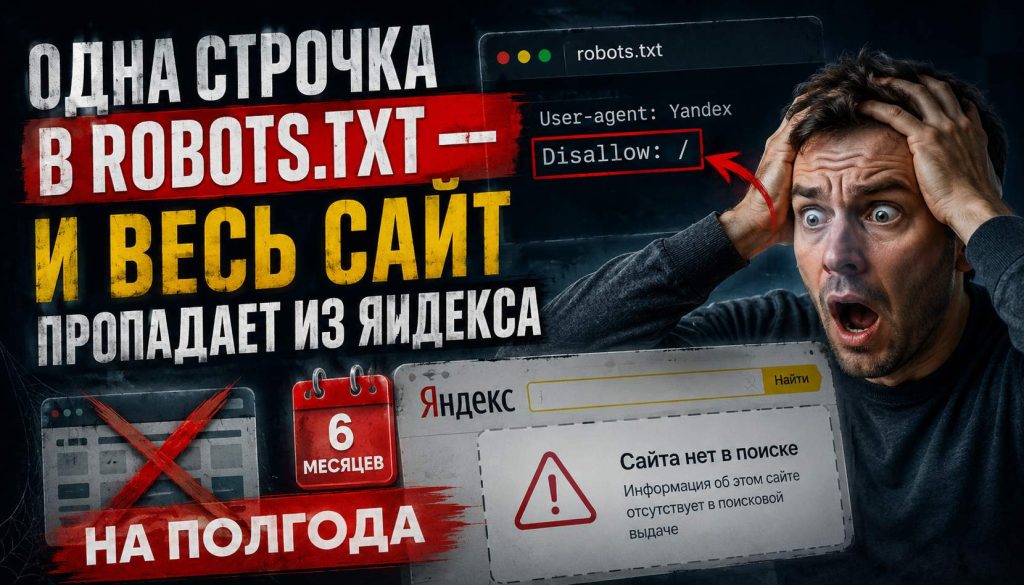

Этот файл — robots.txt. Маленький текстовый документ в корне сайта, который большинство владельцев бизнеса в глаза не видели. Но именно он первым здоровается с поисковыми роботами Яндекса и Google. И если в этом приветствии есть хоть одна некорректная директива — сайт может пропасть из выдачи на полгода. А иногда и навсегда.

Давайте разберёмся, как одна строка ломает то, что строилось годами, и что с этим делать.

Почему robots.txt — самый недооценённый файл вашего сайта

Робот Яндекса (YandexBot) приходит на сайт по строгому протоколу. Первое, что он делает, — запрашивает https://вашсайт.ру/robots.txt. До того, как он откроет главную страницу, прочитает заголовки, посмотрит на скорость загрузки — он читает этот файл. И ровно по нему принимает решение: что индексировать, что игнорировать, а что вообще не открывать.

Парадокс в том, что именно потому, что файл такой простой, к нему относятся беспечно. Программист правит CMS, верстальщик переносит сайт на новый домен, маркетолог ставит «закройте от индексации тестовую копию» — и одна строка переезжает туда, где она не должна стоять. Никто не проверяет. Сайт работает. Открывается. Заказы идут — пока за счёт повторных клиентов и контекста.

А через две недели звонит владелец: «Анатолий, у нас обвалился трафик из Яндекса. На 90%. Что делать?»

Та самая роковая строка

Вот она. Запомните её:

User-agent: *

Disallow: /Эти две строки означают одно: «Уважаемые поисковые роботы, пожалуйста, не индексируйте мой сайт. Никакие страницы. Никогда.» Один слэш после Disallow. Один символ. И сайт исчезает из выдачи.

«Так это же очевидная ошибка, кто такое напишет?» — спросите вы. Отвечаю на основе реальной практики: почти каждый второй сайт, который мне присылают на аудит после переноса с тестового сервера, поддомена разработки или редизайна — имеет именно эту директиву. Разработчики ставят её на стейджинг, чтобы тестовая версия не попала в индекс. А при переносе на боевой домен забывают убрать.

Если хотите проверить свой сайт прямо сейчас, я бы советовал начать с бесплатного экспресс-аудита — он за 30 секунд покажет, открыт ли сайт для индексации, корректен ли robots.txt и нет ли в нём блокирующих директив.

Почему именно полгода — и почему не неделя

Здесь начинается самое неприятное. Многие думают: «Ну ошиблись, поправили — через пару дней Яндекс всё восстановит». Не восстановит.

Механика следующая. Когда робот видит Disallow: /, он перестаёт ходить на сайт. Не на час. Не на день. Робот переключает сайт в режим «не сканировать» и приходит проверять robots.txt уже не каждый день, а раз в несколько недель — иногда раз в месяц. То есть даже после того, как вы исправили файл, Яндекс ещё долго не знает об этом.

Дальше включается второй механизм — деиндексация. Страницы постепенно выпадают из выдачи: сначала самые редко обновляемые, потом коммерческие посадочные, потом главная. На полное выпадение уходит от двух до восьми недель в зависимости от траста сайта. А обратный процесс — переиндексация и возврат позиций — занимает кратно больше: 3–6 месяцев в среднем, иногда до года для крупных проектов.

Это не «фильтр» и не санкция. Это простая алгоритмическая инерция: Яндекс не наказывает, он просто медленно возвращает доверие к ресурсу, который сам себя отключил. Поведенческие факторы, накопленный трастовый профиль, частота сканирования — всё это приходится отстраивать заново.

Семь убийственных ошибок в robots.txt, которые я вижу регулярно

За время работы я выработал внутренний чек-лист — те ошибки, которые встречаются чаще всего и стоят клиентам сотен тысяч рублей упущенной выручки. Перечислю их в порядке частоты.

1. Disallow: / на боевом сайте

Уже разобрали. Самая распространённая катастрофа. Возникает после переноса с тестового домена, после установки плагина обслуживания (типа «Сайт временно недоступен») или после смены хостинга, когда программист копирует robots.txt из dev-окружения.

2. Запрет служебных папок вместе с контентом

Классика для сайтов на WordPress. Владелец слышит «закройте админку от индексации» и ставит:

Disallow: /wp-А вместе с /wp-admin/ закрывается /wp-content/uploads/ — то есть все картинки сайта. Поисковая выдача по картинкам обнуляется, а с ней — большой пласт трафика для интернет-магазинов и блогов.

3. Блокировка CSS и JS файлов

Старая школа SEO учила закрывать всё, что не контент. Сегодня это путь к катастрофе. Яндекс и Google рендерят страницу как браузер — им нужны стили и скрипты, чтобы понять структуру и оценить мобильную адаптивность. Если CSS и JS закрыты, робот видит «голый» HTML, считает сайт неоптимизированным под мобильные и снижает позиции. На этапе доработки сайта я в 8 случаях из 10 встречаю именно эту проблему у клиентов, пришедших от прошлых подрядчиков.

4. Конфликт Allow и Disallow

Когда в файле одновременно стоит Disallow: /catalog/ и Allow: /catalog/category/, разные роботы интерпретируют это по-разному. Яндекс читает директивы последовательно, Google — по специфичности. Результат: страницы то индексируются, то выпадают, позиции скачут. Найти такую ошибку без опыта — почти невозможно.

5. BOM-маркер в начале файла

Это технический ад. Если robots.txt сохранён в кодировке UTF-8 с BOM (Byte Order Mark), в начало файла добавляется невидимый символ. Глазами вы его не видите. Но Яндекс не понимает первую строку и игнорирует весь файл целиком. Сайт либо начинает индексироваться полностью (включая корзины, личные кабинеты и админки), либо — что хуже — теряет важные директивы Sitemap и Clean-param.

6. Sitemap.xml в неправильном формате

Директива должна выглядеть как Sitemap: https://сайт.ру/sitemap.xml — с полным абсолютным URL и протоколом. Сокращённые записи вида /sitemap.xml Яндекс не считывает, и карта сайта не попадает в Вебмастер. Индексация новых страниц замедляется в разы.

7. Crawl-delay в несколько секунд

Раньше эту директиву использовали, чтобы снизить нагрузку на хостинг. Сегодня Яндекс её всё ещё уважает, а Google — игнорирует. Если кто-то выставил Crawl-delay: 10, робот Яндекса делает паузу 10 секунд между запросами. Для сайта в 5000 страниц это означает, что полный обход занимает почти 14 часов вместо 30 минут. Индексация новых разделов растягивается на недели.

Как понять, что виноват именно robots.txt

Если у вас обвалился трафик из Яндекса — не торопитесь грешить на алгоритмы. Сначала проверьте три вещи.

Первое — откройте файл вручную. Введите в адресную строку https://вашсайт.ру/robots.txt и прочитайте его глазами. Если видите Disallow: / без условий — поздравляю, причина найдена.

Второе — Яндекс.Вебмастер. В разделе «Инструменты → Анализ robots.txt» вставьте URL любой важной страницы и проверьте, разрешена ли она к индексации. Если Вебмастер пишет «Запрещено директивой» — система видит блокировку.

Третье — динамика индекса. В разделе «Индексирование → Страницы в поиске» посмотрите график. Резкое падение количества проиндексированных страниц на 50%+ за 2–4 недели — почти всегда симптом проблемы с robots.txt или meta noindex, а не с алгоритмами.

Подробный разбор всех технических аспектов индексации я делаю в рамках SEO-аудита сайта — это та точка, с которой стоит начинать любой проект, где нужно вернуть позиции.

Что делать, если сайт уже выпал

План действий зависит от того, как давно произошла ошибка. Если меньше двух недель назад — есть шанс на быстрое восстановление. Если больше месяца — готовьтесь к серьёзной работе.

Алгоритм такой. Сначала исправляете robots.txt — убираете блокирующие директивы, оставляете только корректные правила для конкретных служебных разделов. Затем в Яндекс.Вебмастере отправляете обновлённый файл на переобход через инструмент «Анализ robots.txt». После этого через раздел «Переобход страниц» вручную добавляете 10–20 самых важных URL — главную, ключевые посадочные, разделы каталога. Это даёт сигнал роботу, что сайт жив и доступен.

Параллельно нужно усиливать сигналы качества: публиковать новый контент, наращивать ссылочный профиль, работать с поведенческими факторами. Без этого простое исправление robots.txt вернёт сайт в индекс, но не вернёт позиции — Яндекс сначала поставит ресурс «на испытательный срок».

Именно поэтому возврат после deindexации — это не «правка одной строки», а полноценный SEO-проект на 4–6 месяцев. Я неоднократно вытаскивал клиентов из такой ямы — реальные истории и цифры собраны в разделе кейсов.

Несколько простых правил, которые я внедряю на всех клиентских проектах:

Robots.txt должен проверяться каждый раз после любых работ с сайтом — переноса, обновления CMS, установки нового плагина, смены хостинга. Это пятиминутная процедура, которая экономит сотни тысяч рублей.

На тестовых поддоменах и стейджингах закрывайте сайт от индексации не через Disallow: /, а через HTTP-авторизацию или meta-тег noindex. Так при переносе на боевой домен ошибка исключена физически — нечего забыть переключить.

В Яндекс.Вебмастере включите уведомления о критических ошибках индексации. Если robots.txt станет невалидным или большое количество страниц выпадет из индекса — вы узнаете об этом в первые сутки, а не через два месяца.

И главное — не доверяйте robots.txt программистам, которые «просто кодят». Этот файл — зона ответственности SEO-специалиста, и редактировать его должен человек, который понимает, как директивы влияют на ранжирование. Хороший контент и грамотно сделанный сайт не спасут, если на старте робот получит команду «не входить».

Вместо итога

Файл robots.txt — это самая дешёвая и самая опасная часть SEO. Стоимость его настройки — ноль рублей. Стоимость ошибки в нём — полгода без органического трафика, потерянные клиенты, упавшая выручка и испорченные нервы.

Хорошая новость: проверка занимает 5 минут. Плохая: большинство владельцев сайтов её не делают, пока не становится поздно.

Если вы дочитали до этого места — у меня к вам предложение

Скорее всего, вы здесь не случайно. Либо вы уже подозреваете, что с вашим сайтом что-то не так — позиции просели, трафик из Яндекса не растёт, заявок меньше, чем должно быть. Либо вы понимаете, что сайт работает «вполсилы», и хотите выжать из него реальный коммерческий результат.

Я — Анатолий Кузнецов, SEO-практик с 2003 года. За это время я провёл сотни проектов в ТОП-3 Яндекса и ни разу не получил фильтр от поисковой системы — потому что работаю только белыми методами. И я готов лично разобраться с вашим сайтом.

Что я предлагаю:

1. Бесплатный технический аудит за 24 часа. Без обязательств, без подписок, без «оставьте телефон, мы перезвоним через неделю». Я лично проверю robots.txt, индексацию, мета-теги, скорость, структуру, конкурентов в вашей нише. Вы получите отчёт с конкретными точками роста и пониманием, сколько трафика и заявок реально достижимо именно для вашего бизнеса. Заказать бесплатный аудит →

2. SEO-продвижение на результат — от 55 000 ₽/месяц. Беру в работу один проект на нишу — поэтому ваши конкуренты не получат от меня тех же приёмов. Работаю напрямую, без менеджеров и посредников. Еженедельные отчёты, прозрачная аналитика, рост позиций → трафика → звонков → продаж. Средний рост трафика у моих клиентов — 340% за 6 месяцев. Узнать о SEO-продвижении →

3. Если сайт уже выпал из Яндекса — не ждите, пока ситуация ухудшится. Каждая неделя простоя — это месяцы восстановления. Напишите мне напрямую, и я скажу честно: можно ли вернуть позиции, за какой срок и какой бюджет потребуется. Без сказок про «ТОП за две недели». Связаться со мной →

Я не работаю со всеми подряд — берусь только за те проекты, где уверен в результате на 98%. Если ваша ниша свободна, и я вижу потенциал — мы выводим сайт в ТОП. Если потенциала нет — я честно скажу об этом и не возьму ваши деньги.

Место в вашей нише пока свободно. Конкуренты тоже про это не знают. Пока.

→ Получить бесплатный аудит сайта

Увеличьте позиции и продажи вашего сайта

Профессиональное SEO-продвижение с гарантией результата. Выберите подходящую услугу:

Остались вопросы по продвижению?

Меня зовут Анатолий Кузнецов, я SEO-оптимизатор с 20-летним стажем. Разберу ваш сайт, отвечу на вопросы и подскажу, что улучшить для роста позиций в Яндексе и Google.

Связаться со мной →

Старт

Старт  Стандарт

Стандарт  Премиум

Премиум